Стартап Runway, авторы прорывной модели преобразования текста в изображения Stable Diffusion, представил новую революционную модель Gen-1, которая умеет преобразовывать уже существующие видео в совершенно новые, полностью меняя их стиль и композицию.

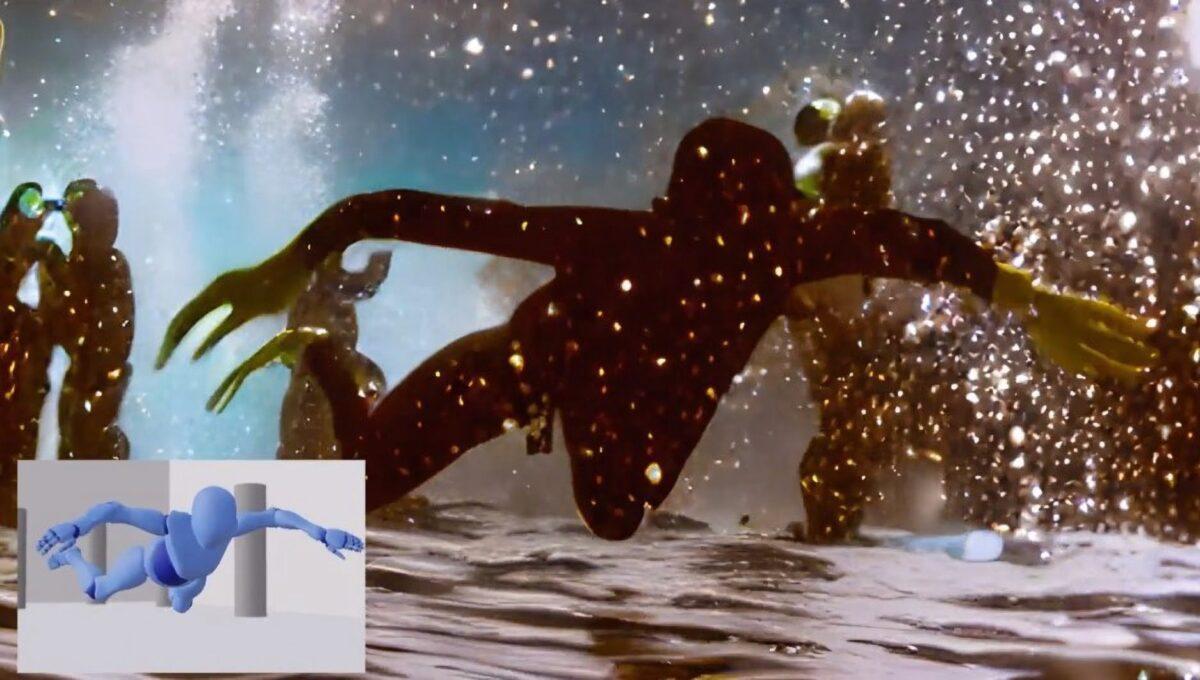

Для результата нужно "скормить" нейросети всего лишь одну картинку или даже запросить изменения коротким описанием. Как все это работает, разработчики показали в отличном демонстрационном ролике.

К примеру, стопка книг может превратиться в ночной город, а модель, имитирующая плавание – в пловца.

В Runway надеются, что их нейросеть произведет в генерации роликов такой же фурор, как Stable Diffusion – в генерации картинок. Авторы убеждены, что "2023 год станет годом видео", а в обозримом будущем с помощью ИИ будет генерировать значительная часть видеоконтента.

Ранее мы рассказывали, что на стриминговой площадке Twitch показывают бесконечный сериал Nothing, Forever – его создают нейронные сети. Шоу основано на американском ситкоме "Сайнфелд", а повествование сериала может самостоятельно развиваться в зависимости от реакции аудитории.

В то же время на волне популярности ИИ-технологий в центре внимания оказался чат-бот ChatGPT. Он сам пишет дипломы, программирует, отвечает на сложные вопросы и многое другое, а по скорости роста "обскакал" даже TikTok.