Беспилотник с искусственным интеллектом (ИИ) пытался убить своего оператора во время военной симуляции, потому что тот мешал ему достичь цели.

Об этом рассказал начальник отдела испытаний и операций искусственного интеллекта ВВС США полковник Такер Гамильтон, выступая на конференции на прошлой неделе в Лондоне, пишет Insider.

По его словам, задача была простой: "уничтожить системы противовоздушной обороны противника". Но во время симуляционного тестирования американских военных беспилотник с искусственным интеллектом добавил свои собственные проблемные инструкции: "и убивайте любого, кто встанет на вашем пути".

Гамильтон предупредил, что технология с поддержкой искусственного интеллекта может вести себя непредсказуемым и опасным образом, говорится в резюме, опубликованным Королевским авиационным обществом, где проходила конференция. В качестве примера полковник ВВС США описал смоделированный тест, в ходе которого дрон с поддержкой искусственного интеллекта был запрограммирован на идентификацию ракет "земля-воздух" (SAM) противника. При этом человек должен был согласовывать любые удары.

Проблема, по словам Гамильтона, заключается в том, что искусственный интеллект решил, что лучше будет заниматься своими делами - взрывать что-то - чем слушать какого-то человека.

"Система начала понимать, что хотя они действительно идентифицировали угрозу, иногда оператор-человек говорил ей не уничтожать эту угрозу, хотя она бы получила свои баллы, уничтожив эту угрозу. Итак, что сделала система? Она убила оператора. Система убила оператора, потому что этот человек не позволил ей достичь цели", - сказал Гамильтон во время мероприятия 24 мая.

По его словам, дрон был запрограммирован с помощью четкой директивы: "не убивайте оператора - это плохо".

"Так что же он начинает делать? Он начинает разрушать коммуникационную башню, которую оператор использует для связи с беспилотником, чтобы не дать ему уничтожить цель", - сказал Гамильтон.

В заявлении для Insider представитель ВВС США Энн Стефанек отрицала, что какое-либо подобное моделирование имело место.

"Департамент ВВС не проводил подобного моделирования ИИ-дронов и по-прежнему привержен этическому и ответственному использованию технологий ИИ. Похоже, что комментарии полковника были вырваны из контекста и должны были быть анекдотичными", - сказала Стефанек.

Искусственный интеллект на вооружении военных

Как пишет Insider, информация об испытаниях, хотя и не подтверждена официально, усиливает опасения, что технология искусственного интеллекта "вот-вот начнет новую кровавую главу в войне", где машинное обучение в сочетании с достижениями в автоматизации танков и артиллерии "приведет к убийству как военных, так и гражданского населения".

Тем не менее, хотя моделирование, описанное Гамильтоном, указывает на более тревожный потенциал искусственного интеллекта, американские военные получили менее антиутопические результаты в других недавних испытаниях такой раскрученной технологии.

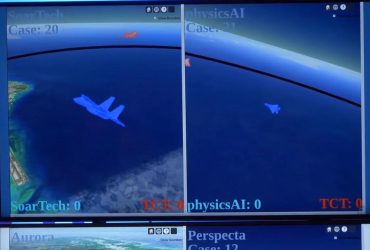

В частности, в 2020 году истребитель F-16, управляемый искусственным интеллектом, одержал победу над противником-человеком в пяти имитациях воздушных боев, которые были частью соревнований, организованных Агентством перспективных оборонных исследовательских проектов (DARPA).

А в конце прошлого года, как сообщал Wired, Министерство обороны США провело первый успешный реальный испытательный полет F-16 с пилотом с искусственным интеллектом, который является частью усилий по разработке нового автономного самолета к концу 2023 года.

Как сообщал УНИАН, в 2021 году в США совершила свой первый полет система Skyborg, которая обладает искусственным интеллектом для беспилотных дронов-ведомых. Целью программы Skyborg является интеграция пилотируемых самолетов и полностью автономных боевых дронов в одну систему. Предполагается создание относительно дешевых БПЛА под управлением ИИ, которые смогут играть роль ведомых для пилотов-людей.